Sa théorie de l’information a donné naissance à la compression numérique, capable de délivrer le maximum de données de façon la moins onéreuse possible. Il aurait eu 100 ans ce mois-ci.

Sans lui, nous n’aurions ni téléphone portable dans nos poches, ni albums photos sur les disques durs de nos ordinateurs, ni DVD sur les rayonnages de nos bibliothèques. Nous ne pourrions pas télécharger ou échanger nos chansons favorites sur Internet. Snapchat et les jeux vidéo ne feraient pas partie du quotidien des « millennials « . Pas de visioconférences entre cadres aux deux bouts de la planète, pas de Wikipedia pour venir à l’aide des écoliers à la veille d’un exposé, pas de paraboles pointées vers le ciel pour recevoir les signaux des satellites… C’est peu dire que le mathématicien et ingénieur américain Claude Shannon, dont l’année 2016 marque le centenaire de la naissance, comme 2012 avait célébré celle du Britannique Alan Turing, a puissamment contribué à façonner notre société et nos vies. « Il est à coup sûr l’un des pionniers les plus importants de l’âge de l’information « , résume le spécialiste du traitement du signal Patrick Flandrin, de l’ENS Lyon.

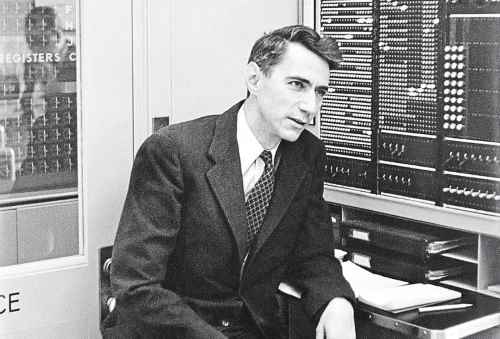

Malgré cette omniprésence, le père de la théorie mathématique de l’information reste méconnu du grand public. Contrairement au tombeur d’Enigma et co-inventeur de l’ordinateur, aucun film ne lui a été consacré. Il y aurait pourtant matière, tant le plus génial des ingénieurs des Bell Labs fut un être excentrique, collectionnant avec constance les hobbies bizarres (lire ci-dessous). Par un cruel coup du sort, il manquera de peu de voir déferler sur le monde la lame de fond d’Internet et de ces « nouvelles technologies de l’information et de la communication » dont il avait posé les bases théoriques : frappé par la maladie d’Alzheimer, il s’est éteint en février 2001 dans une maison de retraite du Massachusetts.

Information et incertitude

Comme pour ceux d’Alan Turing (qu’il a d’ailleurs rencontré en 1943 à Washington), c’est dans le fracas de la Seconde Guerre mondiale que s’enracinent les travaux révolutionnaires de Claude Shannon, employé lui aussi comme cryptographe au service de l’armée. L’année décisive vient un peu plus tard, en 1948, date de la publication de son article phare, « A Mathematical Theory of Communications « . Quelques mois plus tôt, trois autres ingénieurs Bell de Murray Hill, dans le New Jersey, avaient mis au point le premier transistor. Une coïncidence dont s’émerveille encore l’un des scientifiques français les plus cités dans les sciences de l’information, Claude Berrou : « Que, dans le même lieu, à quelques mois d’intervalle, aient été inventés successivement le composant capable de représenter une valeur binaire, 0/1, et la théorie qui allait accompagner le développement de l’informatique et des télécommunications, cela constitue à mes yeux le fait le plus marquant de la science du XXe siècle. C’est un double big bang. «

L’article de 1948 a jeté les fondations sur lesquelles repose la société de l’information. « Claude Shannon a été le premier à se poser la question clef : « Qu’est-ce que l’information ? », poursuit Claude Berrou. Il choisit de la définir comme ce qui permet de lever une incertitude. « Un petit exemple aidera à comprendre le lien entre ces deux notions. Supposons une source capable d’émettre à chaque seconde un « 0 » ou un « 1 ». Si on règle la source de telle sorte qu’elle n’émette que des « 0 » (ou que des « 1 »), chaque nouveau signal, dont le résultat est totalement prévisible et qui ne lève donc aucune incertitude, n’apporte aucune information. Si, au contraire, la source est réglée de telle sorte qu’elle émette à chaque seconde aléatoirement un « 0 » ou un « 1 », l’information de chaque nouveau message est maximale. Ainsi définie, l’information apparaît dans la théorie de Shannon comme une notion essentiellement probabiliste. Elle devient également quantifiable. C’est d’ailleurs au mathématicien des Bell Labs que l’on doit d’avoir imposé le terme de bit, contraction de « binary digit » (chiffre binaire), comme mesure élémentaire de l’information.

Deux autres notions familières à nos oreilles d’enfants de l’ère numérique, et qui nous viennent tout droit de la théorie de Shannon, sont celles de redondance et de bruit. « En bon ingénieur des télécoms, Claude Shannon s’est demandé comment transmettre le maximum d’informations de la façon la plus efficace et la moins onéreuse possible « , explique Claude Berrou. La solution consiste à la compacter, en éliminant le plus de bits inutiles. Cette compression numérique, que les spécialistes désignent par l’expression de « codage de source « , a trouvé sa traduction concrète dans les formats que nous utilisons pour transmettre de l’image (JPEG), du son (MP3), etc.

La compression de données vise à éliminer du message tout ce qui n’est pas utile à la transmission de l’information, redondant. Mais, en théorie de l’information, il y a redondance et redondance : l’utile et l’inutile, la bonne et la mauvaise. Cela est lié à l’autre notion héritée de Shannon, celle de bruit : tout ce qui est susceptible de parasiter l’information contenue dans un message lorsque celui-ci transite par un canal (quel qu’il soit) de la source au destinataire.

La présence de bruit risquant d’altérer l’intégrité de l’information rend nécessaire une autre opération de codage, symétrique de la première et appelée le « codage de canal » ou « codage correcteur d’erreurs « ; à l’inverse de la compression, elle consiste à ajouter de la (bonne) redondance, exactement comme on double un système électronique dans un avion ou une fusée pour éviter toute panne catastrophique.

Deux théorèmes de Shannon assignent des limites indépassables à la compression comme aux codes correcteurs – dans ce second cas, les « turbocodes » mis au point par Claude Berrou, et sans lesquels la téléphonie mobile ne fonctionnerait pas, s’approchent de cette asymptote théorique.

Une théorie universelle

Près de soixante-dix ans après avoir été formulée, la théorie de l’information n’a pas seulement donné son visage au monde moderne. Elle a aussi essaimé dans d’autres sciences. Cela tient à l’une de ses caractéristiques essentielles, qui fait à la fois sa force et sa limite : son universalité.

Si elle s’intéresse à la quantité d’informations contenues dans un message, la théorie de Shannon fait en revanche complètement l’impasse sur la qualité de celui-ci, sa signification – tout ce qui relève, en d’autres termes, de la sémantique. « Pour Shannon, dit plaisamment Claude Berrou, « amour » et « haine » ne sont que deux mots de cinq lettres prises dans un alphabet qui en compte vingt-six. Et les réponses aux questions « Dieu existe-t-il ? » et « Va-t-il pleuvoir sur Brest aujourd’hui ? » apportent l’une comme l’autre un bit d’information (oui/non). »

Cette indifférence au contenu sémantique du message et au support physique de celui-ci lui permet de s’appliquer à bien d’autres domaines que la transmission de données numériques. « On pense évidemment à la génétique, avec les séquences d’ADN qui s’écrivent au moyen d’un alphabet de quatre lettres [les nucléotides A, C, G, T, NDLR] et peuvent être facilement codées en langage binaire « , souligne Patrick Flandrin. « Les liens se multiplient aussi avec les neurosciences », ajoute Claude Berrou, qui étudie actuellement le fonctionnement du cerveau à travers le prisme de la théorie de l’information. « Un champ de recherches passionnant « , commente-t-il. On veut bien le croire !

2016, Année Shannon

L’Année Shannon, lancée par l’« Information Theory Society « , sera marquée par une série d’événements http://www.itsoc.org/resources/Shannon-Centenary à travers le monde, de Cambridge (Massachusetts), siège du MIT où Shannon a travaillé de 1958 à 1978, à Bombay , en passant par Ottawa, Hong Kong, Göteborg…

En France également, plusieurs événements seront organisés.

Le 13 avril, le mathématicien Josselin Garnier donnera à la BNF, à l’initiative de la Société mathématique de France, une conférence intitulée « Claude Shannon et l’avènement de l’ère numérique ».

De son côté, l’Institut Henri-Poincaré proposera cet automne un atelier « La théorie de l’information aujourd’hui « .

Auteur : Yann Verdo

Source : www.lesechos.fr

En savoir plus sur Invention - Europe

Abonnez-vous pour recevoir les derniers articles par e-mail.